ChatGPT、使えない」と思った人の9割が知らない”たった1つの真実”

「ChatGPTに質問したら、嘘の情報を堂々と返してきた」

「最新のニュースを聞いたら『知りません』って…ググったほうが早いじゃん」

あなたの指は、すでにブラウザの「×」ボタンに向かっている。ChatGPTとの短い蜜月は終わった。結局、Google検索に戻る日々だ。

だが、待て。

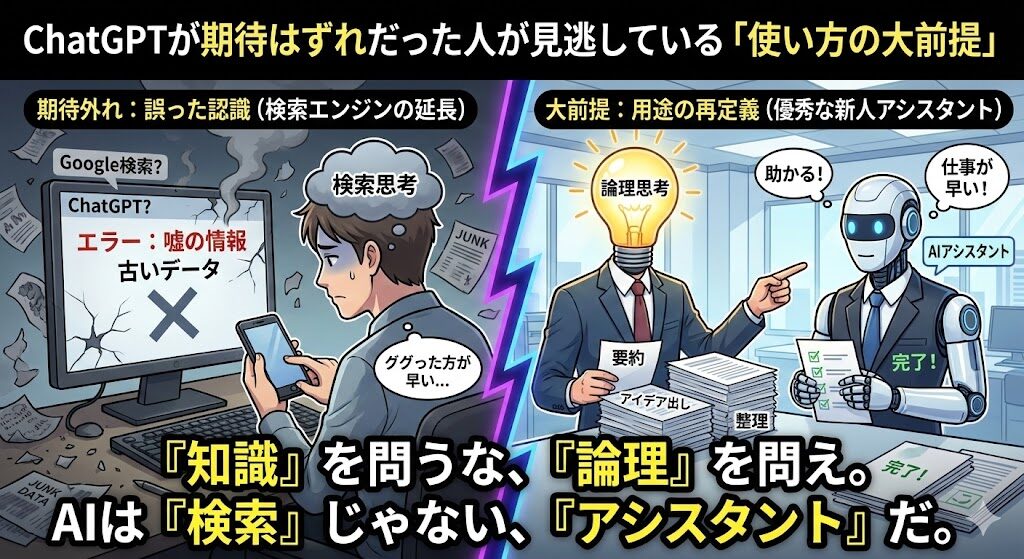

もしあなたがそう感じたなら、それはChatGPTの問題ではない。使い方の大前提を、根本的に間違えている。

月明かりの下、影を踏んで遊ぶ子供のように、あなたはツールの「表層」だけを見て、その本質を完全に見逃している。ChatGPTに失望した瞬間、実はあなた自身の思考様式——「Google脳」という名の呪い——が露呈しただけだ。

この記事を読み終える頃、あなたは気づくだろう。問題は「AIの性能」ではなく、「質問の仕方」でもなく、もっと深い場所にある。それは、私たちが10年以上かけて染み付いた「答えを得る」という思考習慣そのものだ。

ChatGPTは検索エンジンではない——世界は「知識量」で競う時代を終えた

あなたが抱いている幻想

多くの人は、ChatGPTを「高性能Google」だと思っている。

- 質問を入力すれば、正確な答えが返ってくる

- 最新の情報を網羅している

- 事実を間違えない

だから、ChatGPTが「2024年の日本の人口は?」に答えられず、「iPhoneの最新価格は?」で古いデータを返し、たまに存在しない論文を引用したりすると——「使えない」と判断する。

この判断は、完全に正しい。

だが、それは「包丁で釘を打てない」と文句を言うのと同じだ。ツールを間違えているのは、ChatGPTではなく、あなただ。

破壊すべき概念:「AIは万能データベース」という洗脳

社会は私たちに、こう刷り込んできた。

「優れたツール = より多くの知識を持つもの」

だから、Googleが百科事典を駆逐し、Wikipediaが図書館を置き換えた。情報量こそが、ツールの価値基準だった。

だが、この価値観は2023年11月30日に終わった。

ChatGPTの登場は、こう宣言した。

「知識の量」ではなく「思考の質」が、次の時代の通貨である。

考えてみてほしい。あなたは本当に「知識」が欲しいのか?

違う。欲しいのは「知識を使って、自分の問題を解決する方法」だ。

そして、その「方法」は、100万件のGoogle検索結果の中には存在しない。なぜなら、あなたの問題は世界で一つだけだからだ。

新概念の提示:「薄い横の知識」と「濃い縦の思考」

ここで、従来の情報ツールを再定義する。

Google検索 = 薄い横の知識

- 広く、浅く、大量の情報を並べる

- 「何を知っているか」が価値基準

- 結果:情報の海で溺れる

ChatGPT = 濃い縦の思考

- 狭く、深く、特定の問題を掘り下げる

- 「どう考えるか」が価値基準

- 結果:思考のプロセスが可視化される

あなたが「ChatGPTは使えない」と感じたのは、横の知識を求めて、縦の思考ツールを使ったからだ。

魚屋で肉を買おうとして、「品揃えが悪い」と文句を言っているに等しい。

「嘘をつくAI」は欠点ではない——不完全性こそが、思考を育てる

共通の敵:「完璧主義という名の思考停止」

ここで、明確に敵を名指しする。

あなたを苦しめているのは、ChatGPTの不正確さではない。「正解を即座に得られるべき」という傲慢な期待だ。

この期待は、Google検索が10年かけて私たちに植え付けた「答えハラスメント」——つまり、「考えるより、検索したほうが速い」という思考様式——の産物である。

だが、よく思い出してほしい。

人類史上、最も価値ある発見や洞察は、「正しい答え」からではなく、「間違った仮説」から生まれた。

- ニュートンの万有引力:リンゴが落ちる「なぜ?」から

- ペニシリンの発見:カビが生えた「失敗実験」から

- アインシュタインの相対性理論:「もし光の速さで走ったら?」という「妄想」から

間違いは、思考の入り口だ。

そしてChatGPTは、その入り口を——意図的に——あなたに差し出している。

ChatGPTの「嘘」が果たす3つの機能

ChatGPTが事実を間違えるとき、実は以下の3つの価値ある仕事をしている。

1. あなたの批判的思考を呼び覚ます

完璧な答えを受け取ると、人間は思考を停止する。「そうなんだ」で終わる。

だが、明らかにおかしな答えが返ってくると、あなたは考え始める。

「いや、これは違うだろ」「なぜこんな答えになったんだ?」「正しい答えはどうあるべきか?」

この瞬間、あなたは受動的な情報消費者から能動的な思考者に変わる。

2. 前提の矛盾をあぶり出す

ChatGPTの「間違い」の多くは、実はあなたの質問に含まれる曖昧さや矛盾を反映している。

例えば、「効率的な働き方を教えて」と聞いたとき、ChatGPTが的外れな答えを返したら——それは、あなた自身が「効率」を定義できていない証拠だ。

間違った答えは、間違った問いを映す鏡である。

3. 対話を強制する

もしChatGPTが一発で完璧な答えを返したら、あなたは「ありがとう」と言ってブラウザを閉じるだろう。

だが、不完全な答えが返ってくると、あなたは聞き返す。

「もっと具体的に」「別の角度から」「私の状況に当てはめると?」

この往復こそが、ChatGPTの真骨頂だ。対話を重ねるほど、文脈が深まり、回答が研ぎ澄まされる。

明日から変わる「3つの依頼法」——ChatGPTを「検索ツール」から「思考パートナー」に変える

Step 0:今すぐスマホでできる「最初の一歩」

やること:たった一つの質問を変える

今夜、寝る前に、ChatGPTを開いて以下を試せ。

❌ これまで:「ストレス解消法を教えて」

⭕ これから:「今日感じたストレスを3行で書くので、心理学的に分析して原因を3つ挙げて」

この一言で、あなたとChatGPTの関係性が「情報提供者と受領者」から「対話する思考パートナー」に変わる。

Step 1:「情報を聞く」のをやめ、「思考を整理してもらう」(1週間)

具体的な依頼フレーズ3選

依頼1:要約の依頼

「この文章を3行に要約して」

→ 長いメール、記事、契約書などをChatGPTに貼り付ける

使用例:

- 取引先からの10ページの提案書を貼り付け→「要点を3つに絞って」

- 自分が書いた報告書を貼り付け→「冗長な部分を指摘して」

依頼2:論点の抽出

「この会議メモから、決定事項と未解決の課題を箇条書きにして」

→ 散らばった情報を構造化する

使用例:

- Zoomミーティングの議事録をコピペ→「次のアクションアイテムを5つ挙げて」

- ブレストの殴り書きを貼り付け→「実現可能なアイデアから順に並べて」

依頼3:自分の考えの可視化

「今、〇〇について考えているんだけど、私の思考を整理して」

→ モヤモヤを言語化する

使用例:

- 「転職すべきか迷ってる。メリット・デメリットを対比表にして」

- 「新規事業のアイデアがあるけど、リスクを3つ挙げて」

この1週間で起こる変化:

- Google検索の回数が30%減る

- 「考える時間」が可視化される

- 自分の思考の癖に気づく

Step 2:「批判」と「深掘り」を依頼する(1ヶ月)

依頼4:批判的評価

「この企画案の穴を3つ指摘して。そして改善案も出して」

使用例:

- プレゼン資料を貼り付け→「論理の飛躍を全て指摘して」

- 営業提案書を貼り付け→「顧客が疑問に思いそうな点を5つ挙げて」

依頼5:問いの深掘り

「この問題を5W1Hで分解して」

使用例:

- 「売上が下がった」→「いつから? どの商品で? 誰に対して?」と分解してもらう

- 「チームの雰囲気が悪い」→「何が原因? いつから? 誰が? なぜ?」を整理

この1ヶ月で起こる変化:

- 会議での発言が具体的になる

- 上司や顧客からの質問に即答できる

- 「考えが浅い」と言われなくなる

Step 3:「思考の壁打ち相手」として対話する(3ヶ月)

依頼6:反対意見の生成

「私はこう考えているんだけど、反対意見を3パターン考えて」

使用例:

- 「リモートワークを廃止すべき」という自分の主張に対し→「現場社員、人事、経営者の視点から反論して」

- 「この商品は売れる」という確信に対し→「市場、競合、タイミングの観点から懐疑的に見て」

依頼7:アイデアの進化

「このアイデアをベースに、さらに3つのバリエーションを出して」

使用例:

- 「社内SNSを作る」というアイデア→「低コスト版、ハイエンド版、ニッチ特化版の3パターンで展開して」

- 「週報の書き方を変える」という提案→「忙しい人向け、新人向け、経営層向けの3種類で設計して」

この3ヶ月で起こる変化:

- 企画書の通過率が倍増する

- 「あいつは考えが深い」と評価される

- 自分一人で考えるより3倍速く結論に到達する

「それでも使えない」と思う人へ——5つの反論と、使えるキラーフレーズ

反論1:「でも、事実を間違えるツールは信用できない」

あなたの本音:仕事で使うには、正確性が命。嘘の情報を信じて大恥をかいたらどうするんだ。

論理的な回答:ChatGPTに「事実確認」を求めるのが、そもそも用途違い。事実はGoogleで確認し、その事実をどう解釈し、どう使うかをChatGPTに聞け。

使えるキラーフレーズ(社内で使え):「ChatGPTは『情報源』じゃなくて『思考ツール』だから。事実はGoogle、解釈はChatGPTって使い分けてる」

反論2:「でも、最新情報を知らないなら意味がない」

あなたの本音:2021年以降の情報を持ってないって、もう時代遅れじゃん。今のトレンドに対応できないでしょ。

論理的な回答:最新情報は「入力」としてあなたが与えればいい。ChatGPTの役割は、その情報を分析・整理・応用することだ。

具体例:

- あなた:「2024年の日本の人口は1億2400万人らしい。この数字から、今後10年の市場予測を3パターン出して」

- ChatGPT:「少子化加速シナリオ、移民受け入れシナリオ、技術革新シナリオで分析すると…」

使えるキラーフレーズ:「ChatGPTは『知識を持つ』んじゃなくて『知識を使う』ツールだから。最新ニュース入れれば、即座に分析してくれる」

反論3:「でも、結局Googleのほうが速いよね」

あなたの本音:同じ答えを得るのに、なぜわざわざ対話する必要がある? ググったほうが5秒で終わる。

論理的な回答:「同じ答え」を得ようとしているなら、確かにGoogleが速い。だが、「あなただけの答え」が欲しいなら、ChatGPT一択だ。

対比表:| あなたの状況 | Google | ChatGPT ||————|——–|———|| 「プロジェクト管理の方法」を知りたい | ⭕ 5秒で一般論が出る | △ 汎用的な回答 || 「うちのチームに合ったプロジェクト管理」を知りたい | ❌ 検索ワードが定まらない | ⭕ 対話で状況に応じた提案 |

使えるキラーフレーズ:「Googleは『みんなの答え』、ChatGPTは『自分だけの答え』を出すツールだから」

反論4:「でも、時間がかかるじゃん」

あなたの本音:3往復も対話するなんて、忙しいビジネスパーソンには無理。即答が欲しい。

論理的な回答:確かに「即答」は得られない。だが、「考える時間」を3分の1に圧縮できる。

具体的な時間比較:

- 従来:資料を読む(30分) + 考える(60分) + 整理する(30分) = 120分

- ChatGPT活用:資料を貼る(1分) + 対話(15分) + 整理(10分) = 26分

使えるキラーフレーズ:「ChatGPTは『即答』じゃなくて『時短』のツール。考える時間が5分の1になった」

反論5:「でも、結局は自分で考えなきゃダメでしょ」

あなたの本音:AIに頼りすぎると、自分の頭が退化しそう。自分で考える力が大事だ。

論理的な回答:その通り。だからこそ、ChatGPTは「答えを出す」のではなく「考えるプロセスを可視化する」ツールとして使え。

メタファー:ChatGPTは「筋トレのパーソナルトレーナー」だ。

- トレーナーが代わりに腕立て伏せをしたら、あなたの筋肉はつかない

- だが、「あと5回!」「フォームが崩れてる!」と声をかけてくれたら、効果は倍増する

ChatGPTは「思考のパーソナルトレーナー」である。

使えるキラーフレーズ:「ChatGPTに『答え』を求めてる奴は、確かに思考停止する。でも俺は『問いを深める』ために使ってる」

まとめ:明日、あなたがすべきたった一つのこと

この記事を閉じた瞬間、あなたは二つの道に立っている。

道A:何も変えない

- 「ふーん、そうなんだ」と思って、また明日もGoogle検索を開く

- ChatGPTは「試したけど使えなかった」という記憶のまま、ブックマークから消える

- 3年後、周囲が「AIで仕事が3倍速くなった」と言っているのを、羨ましく眺める

道B:一つだけ変える

- 今夜、寝る前に、ChatGPTに一つだけ「依頼」をする

- それは質問ではない。情報を求めるのでもない

- ただ、「今日考えたこと」を書いて、「整理して」と頼む

たったこれだけだ。

例:

「今日、上司に『君の企画は視点が浅い』と言われた。

正直、何が浅いのか分からない。

この状況を、3つの観点で分析してほしい」

ChatGPTは、あなたの思考を映す鏡になる。不完全な鏡だが、だからこそ、あなたは自分の歪みに気づく。

最後に、一つだけ約束しよう。

この記事を読んだあなたが、明日から「ChatGPTに質問する」のをやめ、「ChatGPTに依頼する」ようになったとき——

世界はこう変わる。

- 会議で、あなたの発言が一番的確になる

- 企画書が、一発で通るようになる

- 「あいつは頭の回転が速い」と言われ始める

それは、AIが賢くなったからではない。あなたの思考が、可視化されたからだ。

ChatGPTは、あなたの頭の中の混沌を、言葉という形に変えてくれる。そして、形になった瞬間、あなたは初めて「自分が何を考えていたか」に気づく。

問題は、ChatGPTが使えないことではなかった。問題は、あなたが「考える」ことを、10年間サボってきたことだった。

だが、大丈夫だ。明日から、取り戻せばいい。

ChatGPTという名の「思考のパーソナルトレーナー」が、24時間、あなたを待っている。

さあ、スマホを開け。「教えて」ではなく、「一緒に考えてほしい」と、打ち込め。

あなたの思考は、今夜から変わる。

コメント